Sam Altman, CEO di OpenAI, ha visitato per la seconda volta questo mese Washington per discutere di intelligenza artificiale (AI) con i legislatori americani. Insieme a Christina Montgomery di IBM e Gary Marcus, professore presso l’Università di New York, ha tenuto una presentazione per la commissione del Senato degli Stati Uniti.

Deve essere creata una nuova agenzia governativa per regolamentare

l’IA In risposta a una domanda del senatore John Kennedy della Louisiana su come regolamentare l’IA, Altman ha suggerito l’istituzione di un’agenzia governativa responsabile della definizione degli standard.

“Propongo di creare una nuova entità che sia in grado di rilasciare licenze per ogni sforzo che supera una certa scala di capacità, che può revocare tali licenze e garantire il rispetto delle norme di sicurezza”, ha affermato Altman. Ha aggiunto che questa entità dovrebbe condurre audit indipendenti su ogni tecnologia di intelligenza artificiale.

Il professor Marcus ha citato la Food and Drug Administration (FDA) come modello e ha sostenuto una valutazione della sicurezza per l’intelligenza artificiale simile a quella dei farmaci prima del loro lancio sul mercato.

Secondo lui, l’agenzia dovrebbe essere flessibile e in grado di monitorare ciò che accade nel settore. Dovrebbe valutare i progetti in anticipo e anche dopo il loro lancio, con il potere di interrompere la tecnologia o l’attività aziendale se necessario.

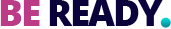

I governi stanno lottando con l’IA

I governi di tutto il mondo stanno ancora cercando di capire come affrontare l’integrazione sempre più diffusa dell’intelligenza artificiale nella vita quotidiana. A dicembre, l’Unione europea ha adottato una legge che promuove l’uso di ambienti di test regolatori guidati dal governo per testare l’IA prima dell’implementazione.

“Per garantire un approccio centrato sull’uomo ed etico all’intelligenza artificiale in Europa, i membri del Parlamento europeo hanno approvato nuove regole per la trasparenza e la gestione del rischio dei sistemi di intelligenza artificiale”, ha riferito il Parlamento europeo.

A marzo, l’Italia ha imposto un divieto sull’utilizzo del ChatGPT di OpenAI, con l’obiettivo di proteggere la privacy. Il divieto è stato revocato ad aprile dopo che OpenAI ha apportato modifiche alle impostazioni sulla privacy, consentendo agli utenti di scegliere di non utilizzare i propri dati per l’addestramento del chatbot e di disattivare la cronologia delle conversazioni.

Conclusioni

La riunione di questi esperti a Washington sottolinea l’importanza crescente dell’intelligenza artificiale e l’urgente necessità di una regolamentazione efficace per massimizzarne i vantaggi e minimizzare i possibili rischi. Mentre il mondo si adatta all’influenza sempre maggiore dell’IA, il dialogo tra legislatori, aziende e accademici rimarrà essenziale per tracciare un percorso equilibrato e sostenibile verso il futuro.